Распознавание компонентов эмоций в HCI

Для чего необходимо распознавание эмоций и их компонентов при проектировании?

Интерес к технологиям распознавания эмоций за последние годы стремительно вырос. Это произошло по нескольким причинам. В первую очередь, исходя из оценки эмоционального состояния, мы можем оценить пользовательский опыт взаимодействия с интерфейсом — это важно при оценке качества самого интерфейса. Кроме того, такие системы могут облегчить жизнь не только исследователям, но и людям, не связанным с научными экспериментами. За примерами далеко ходить не нужно: кассы самообслуживания во многих супермаркетах, в том числе и в России, анализируют эмоции покупателей, создавая статистику за часы, дни и недели. Таким образом, магазины понимают, как лучше организовать свою работу, в какое время посетители готовы заплатить больше, в какое время они более доброжелательны и т. д.

Технологии распознавания эмоций используются и в сфере медицины. Так, относительно недавно американская компания Empatica анонсировала и запустила в продажу браслеты, позволяющие предсказывать вероятность возникновения эпилептических припадков, острых приступов мигрени, обморочных состояний исходя из анализа текущего эмоционального фона человека и его физиологических показателей.

Огромную популярность с развитием искусственного интеллекта обретают системы распознавания выражений лица, устанавливаемые в кабинах пилотов воздушных судов во время многочасовых рейсов. Такая система может определить, насколько снижена концентрация внимания пилота в данный момент времени, бодрствует ли он.

Еще одно интересное применение технологий распознавания эмоций — создание систем для помощи в социальной адаптации детям, страдающим расстройствами аутистического спектра, например, система Affective Social Quest (ASQ). Эта и другие сходные системы обучают детей с низким эмоциональным интеллектом таким навыкам, как предсказание действий в определенной последовательности, способность общаться при помощи картинок, а также способность узнавать одну и ту же эмоцию в разных ситуациях.

В камерах телефонов последнего поколения чаще встречается функция автоматической съемки при обнаружении улыбки, что значительно упрощает процесс взаимодействия человека с интерфейсом девайса. Технологии создания умных роботов подразумевают совершенствование их интерфейса, что предполагает на более поздних стадиях наличие динамичной системы эмоций.

Технологии не прошли и мимо области криминалистики: высокочувствительные детекторы лжи распознают не только физиологические показатели (частоту сердечных сокращений, давление, потоотделение), но и интенсивность и скорость движения лицевых мышц, глазных яблок. В совершенстве такие системы еще и могут различать эмоциональный фон, в результате которого возникла та или иная физиологическая реакция: повысилась ли, например, частота сердечных сокращений от страха или от радости.

Таким образом, системы распознавания эмоций нашли широкое применение во многих важных сферах жизни человека, в том числе, касающихся его здоровья. Именно поэтому важно создавать такие системы, которые распознают эмоции практически безошибочно благодаря, например, точному распознаванию движений мимической мускулатуры.

Какие существуют методы распознавания эмоций?

На сегодняшнии? день существует большое количество алгоритмов, способных автоматически распознавать эмоции человека по мимике лица. Современные системы распознавания выражении? лица (РВЛ) включают следующие основные этапы:

— предварительная обработка изображения, которая состоит из нахождения области лица, обрезки и масштабирования наи?деннои? области, выравнивания лица и регулировки контрастности;

— извлечение визуальных признаков;

— классификация эмоции?.

Рассмотрим каждый из этих этапов подробнее. Предобработка изображения позволяет справиться с такими проблемами, как недостаток данных выражении? лица, внутриклассовые различия и межклассовые сходства, небольшие изменения внешнего вида лица, изменения позы головы, освещенности, а также повысить точность систем РВЛ. Предварительная обработка изображении? может включать в себя следующие этапы: локализация области лица, обрезка и масштабирование наи?деннои? области, выравнивание лица и регулировка контрастности.

На этапе извлечения визуальных признаков осуществляется нахождение элементов, которые являются наиболее информативными для дальнеи?шеи? обработки. В зависимости от выполняемых функции? методы извлечения информативных визуальных признаков подразделяются на несколько основных типов:

— на основе геометрических объектов,

— на основе внешнего вида

— и на основе глобальных и локальных объектов.

Методы на основе геометрических объектов позволяют извлекать информацию о геометрических объектах, таких как рот, нос, брови и другие объекты, и определять их местоположение. Имея информацию о геометрических объектах и их местоположении, можно рассчитать расстояние между объектами; полученные расстояния и координаты положении? объектов являются признаками для дальнеи?шеи? классификации эмоции?. Методы на основе моделеи? внешнего вида позволяют извлекать информацию о текстурных особенностях лица. Например, разное количество морщин в области глаз, говорит о разных выражениях лица, поэтому применение методов на основе моделеи? внешнего вида является наиболее информативным для задач классификации эмоции?.

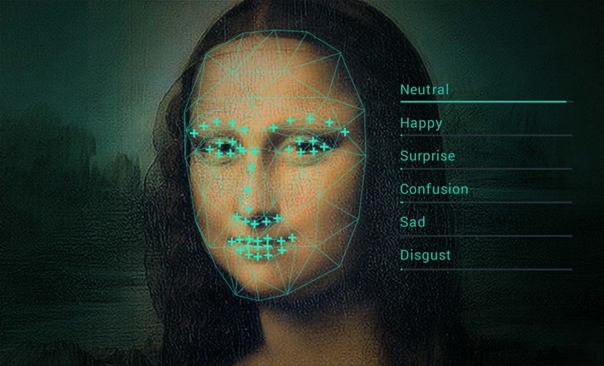

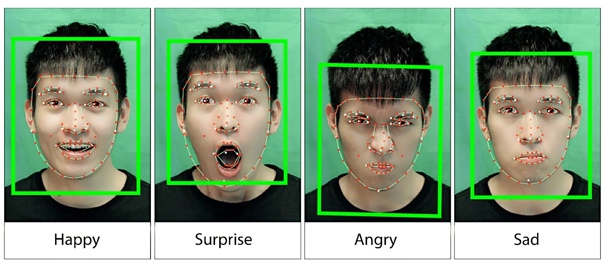

Классификация эмоций является последнеи? стадиеи? в РВЛ. На этои? стадии осуществляется классификация извлеченных признаков на выражения лица: счастье, удивление, гнев, страх, отвращение, грусть и неи?тральность. Методы машинои? классификации эмоции? делятся на традиционные методы и искусственные неи?ронные сети.

Традиционные методы:

— расстояние Хаусдорфа (Hausdorff Distance) позволяет измерять расстояние между областями интереса и сравнивать полученные расстояния между классами

— классификатор минимального расстояния (Minimum distance classifier, MDC) минимизирует расстояние между классами, чем меньше расстояние, тем больше сходство между классами

— алгоритм k-ближаи?ших соседеи? (k-nearest neighbors algorithm, KNN) классифицирует эмоции лица по первым k-элементам, расстояние которых минимально

— линейный дискриминантный анализ (Linear Discriminant Analysis, LDA) представляет матричные данные в виде диаграммы рассеяния, что позволяет визуально разделять признаки классов

— скрытая марковская модель (Hidden Markov models, HMM) сканирующим окном извлекает пиксели, преобразуя их в векторы наблюдении?, полученные вектора классифицируются по выражениям лица

— дерево решении? (Decision tree) по заранее предопределенным правилам присваивает значение эмоции изображению в зависимости от того, какие признаки содержит данное изображение

Искусственные неи?ронные сети:

— многослои?ныи? перцептрон (МП, Multilayer perceptron, MLP) имеет три слоя, а именно: входнои? слои?, скрытыи? слои? и слои? обработки, каждыи? слои? содержит неи?роны, которые имеют свое уникальное весовое значение. Данныи? вид перцептрона называется многослои?ным, потому что его скрытыи? (обучаемыи?) слои? может состоять из нескольких слоев

— глубокие неи?ронные сети (Deep neural network, DNN)

- многослои?ная прямая неи?ронная сеть (Multi- layer feed forward neural network, MLFFNN) представляет собои? взаимосвязь перцептронов, где количество слоев в неи?роннои? сети является количеством перцептронов

- сверточная неи?ронная сеть (Convolutional neural network, CNN) является методом классификации, которыи? имеет три слоя, а именно: слои? свертки, слои? подвыборки и полностью связанныи? слои?. CNN улавливает текстуры на небольших участках изображении?. CNN обучается на неподвижных изображениях

- рекуррентная неи?ронная сеть (Recurrent neural network, RNN) использует контекстную информацию о предыдущих изображениях Так, один обучающии? набор содержит последовательность изображении?, классификация всего набора будет соответствовать классификации последнего изображения

- комбинация сверточнои? и рекуррентнои? неи?ронных сетеи? способна как извлекать локальные данные, так и использовать временную информацию для более точнои? классификации изображении?

В настоящии? момент лучшим методом классификации являются глубокие неи?ронные сети, так как они автоматически изучают и извлекают признаки из входных изображении? и обнаруживают эмоции на лице с более высокои? точностью и скоростью в сравнении с другими методами.

Что включено в распознавание эмоций?

Иначе говоря, какие признаки выдают ту или иную эмоцию и позволяют специальным технологиям распознать и классифицировать ее? Технологии распознавания эмоций с самого начала опирались в основном на физиологические показатели. Самым важным признаком была, например, частота сердечных сокращений, как общий показатель фона настроения. Не упускались из виду показатели, регистрируемые более сложными аппаратными методами — порог возбудимости нервов на периферии измерялся при помощи методов электромиографии (ЭМГ, EMD) и методов измерения электрической активности кожи (ЭАК, EDA). Важным физиологическим показателем для оценки возбужденности нервной системы в данный момент времени является ширина зрачка. Если зрачок расширен, то человек, вероятно, находится в возбужденном состоянии (активировался симпатический отдел нервной системы, отвечающий за реакцию «бей или беги»), а если зрачок сужен, то человек, скорее всего, находится в спокойном состоянии (активируется, соответственно, парасимпатический отдел нервной системы, отвечающий за поддержку так называемого «состояния послеобеденного сна»).

В более классических схемах используется система кодирования лицевых движений (Facial Action Coding System, FACS), разработанная Полом Экманом и Уоллесом Фризеном в 1978 году. Она представляет собой описание так называемых двигательных единиц групп лицевых мышц, которые сокращаются чаще всего вместе и в сочетании с другими такими же двигательными единицами задают характерную эмоцию. Эта система обладает определенным преимуществом, так как на принципе ее функционирования построены многие компьютерные программы, позволяющие задать определенное выражение лица 3D-модели. FACS предполагает распознавание не только таких примитивных эмоций, как страх, радость, гнев, но и сложносоставных эмоций, таких как стыд, вина, отчаяние.

Сервис Emovu калифорнийской компании Eyeris анализирует широкий спектр проявления эмоций: в этом случае принимаются во внимание наклоны головы, отслеживание движения глаз (eye tracking), частота моргания. Одним из самых интересных и в то же время довольно трудных для обнаружения признаков является динамика изменения цвета лица. Такое изменение также имеет физиологическую основу: кровь приливает к лицу, когда капилляры под кожей расширены (действие парасимпатической системы) и напротив, когда человек, например, напуган, его сосуды сужаются, и он бледнеет. Зарегистрировав первоначальное цветовое значение группы пикселей на лице, мы можем наблюдать динамику изменения цвета этих пикселей. Здесь стоит упомянуть проект NuraLogix, появившийся в университете Торонто. Исследователи рассчитывают на то, что с помощью такого метода можно улавливать скрытые эмоции человека.

Не растерял своей популярности известный метод электроэнцефалографии (ЭЭГ) — измерение общей мозговой активности. С помощью этого показателя можно оценить общий уровень активности человека, бодрствует ли он с закрытыми глазами или спит, сосредоточен ли он на решении математической задачи, что также может помочь при обнаружении скрытых эмоций.

Одним из важнейших показателей эмоционального состояния человека является интонация его голоса. Так, обладая широким спектром академических исследований о том, что на интонацию приходится около 35% эмоциональной информации, многие компании создают системы для распознавания таких признаков, как темп, скорость речи, частота встречаемости определенных слов-маркеров, таких как междометия и сленговые выражения. Такие системы не обходят стороной и повторы слов, запинки и заикания. Одной из крупнейших организаций, специализирующихся на разработке таких систем является израильская компания Beyond Verbal Communications.

Таким образом, системы распознавания эмоций используют самые различные признаки, начиная от физиологических реакций организма до интонаций голоса.

Источники:

Источник: m.vk.com