Парикмахерская: Попробуйте разные прически и цвета волос с фотографий (GANs)

Искусственный интеллект может изменить вашу прическу, чтобы увидеть, как вы будете выглядеть, прежде чем идти стричься.

Эта статья не о новой технологии как таковой. Вместо этого речь идет о новом и захватывающем применении GANs. Действительно, вы видели название, и это был не кликбейт. Этот искусственный интеллект может перенести ваши волосы, чтобы увидеть, как они будут выглядеть, прежде чем вносить изменения. Мы все знаем, что может быть трудно изменить свою прическу, даже если бы вы этого хотели. Ну, по крайней мере, для меня, я привык к одной и той же стрижке в течение многих лет, говоря своему парикмахеру «то же, что и в прошлый раз» каждые 3-4 месяца, даже если я хотел бы что-то изменить. Я просто не могу взять на себя обязательство, боюсь, что это будет выглядеть странно и необычно. Конечно, все это у нас в голове, поскольку мы единственные, кто заботится о нашей стрижке, но этот инструмент может изменить правила игры для некоторых из нас, помогая нам решить, стоит ли совершать такие изменения, имея отличное представление о том, как это будет выглядеть на нас. Тем не менее, такие моменты, когда вы можете заглянуть в будущее, прежде чем делать предположения, редки. Даже если это не совсем точно, все равно довольно здорово иметь такое превосходное приближение того, как может выглядеть что-то вроде новой стрижки, избавляя нас от некоторого стресса, связанного с попыткой чего-то нового, сохраняя при этом захватывающую часть. Конечно, стрижки очень поверхностны по сравнению с более полезными приложениями. Тем не менее, это шаг вперед к «видению будущего» с использованием искусственного интеллекта, что довольно круто. Действительно, эта новая техника как бы позволяет нам предсказывать будущее, даже если это просто будущее нашей стрижки. Но прежде чем углубиться в то, как это работает, мне любопытно узнать, что вы думаете по этому поводу. В любой другой области:

Какие еще приложения вы хотели бы видеть с использованием искусственного интеллекта, чтобы «заглянуть в будущее»?

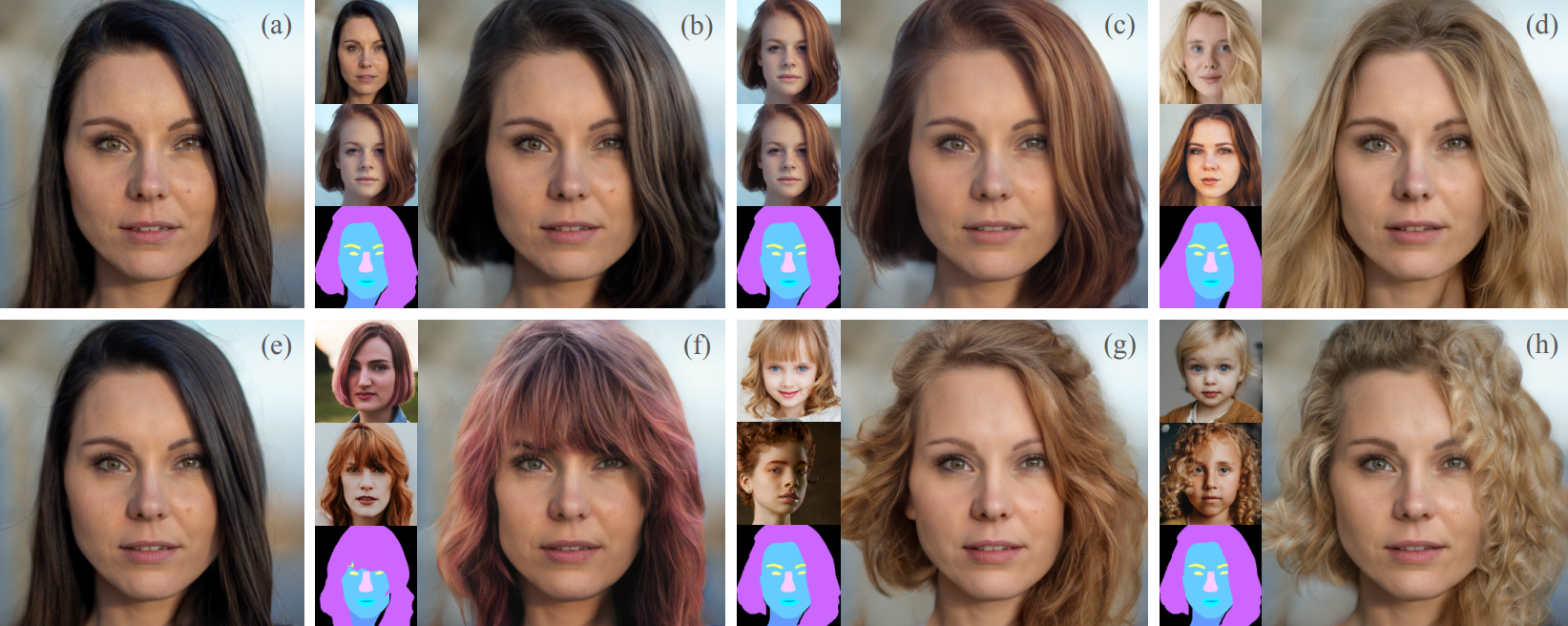

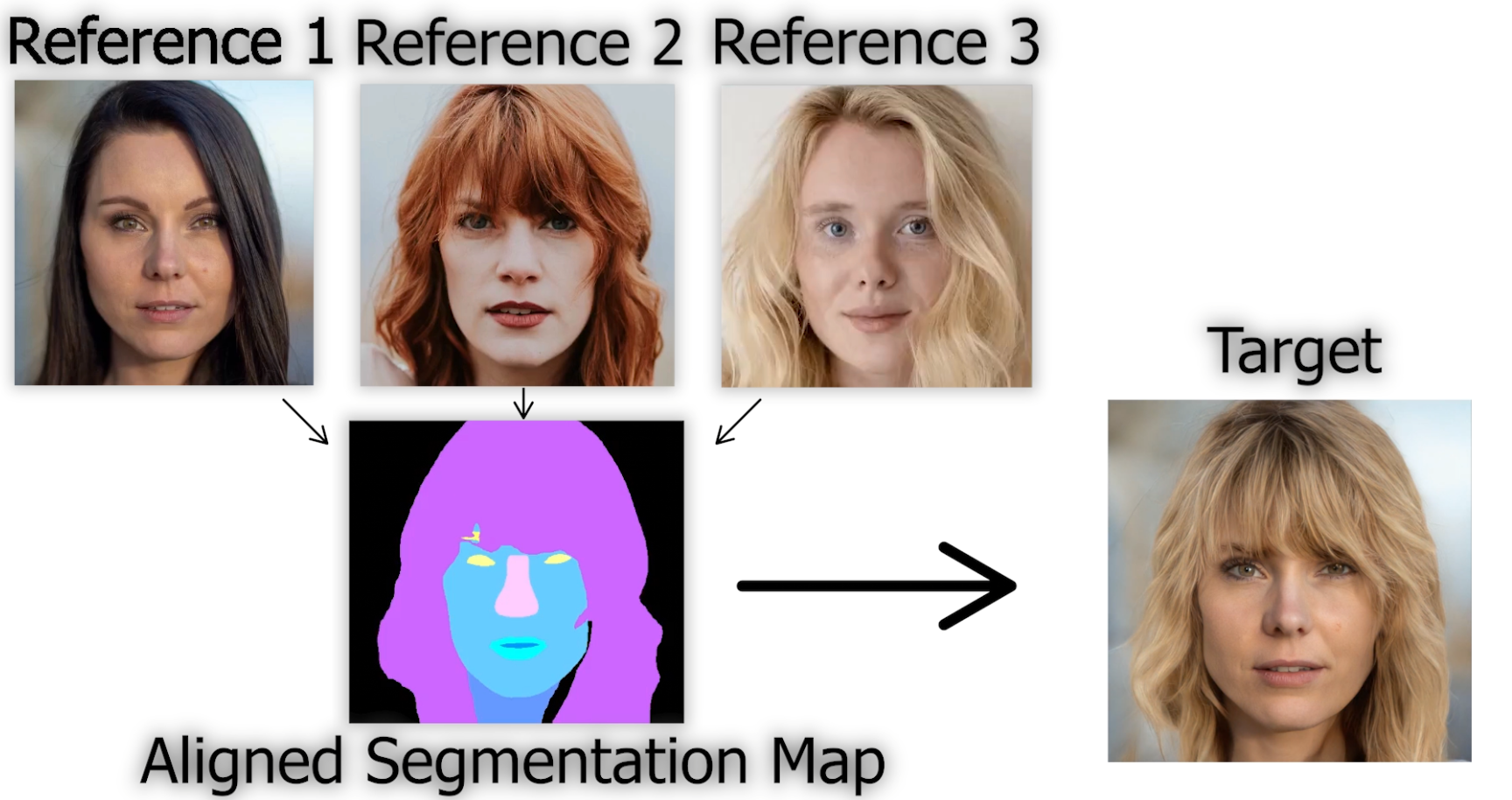

Это может изменить не только стиль ваших волос, но и цвет из нескольких примеров изображений. В принципе, вы можете дать алгоритму три вещи:

свою фотографию

фотографию кого-то с прической, которую вы хотели бы иметь, и

другая фотография (или та же самая) цвета волос, который вы хотели бы попробовать

, и она реалистично объединяет все на себе.

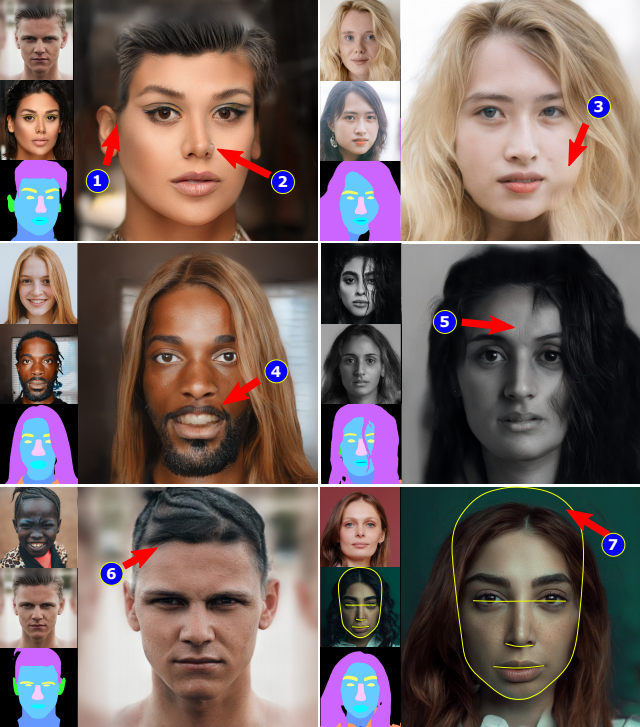

Результаты действительно впечатляют. Алгоритм позволит вам виртуально подстричься бесплатно и мгновенно. Если вы не доверяете моему суждению, как я бы полностью понял, основываясь на моем уровне художественного мастерства, они также провели исследование пользователей на 396 участниках. Их решение было предпочтительным в 95 процентах случаев! Конечно, вы можете найти более подробную информацию об этом исследовании в приведенных ниже ссылках, если вам кажется, что в это слишком трудно поверить.

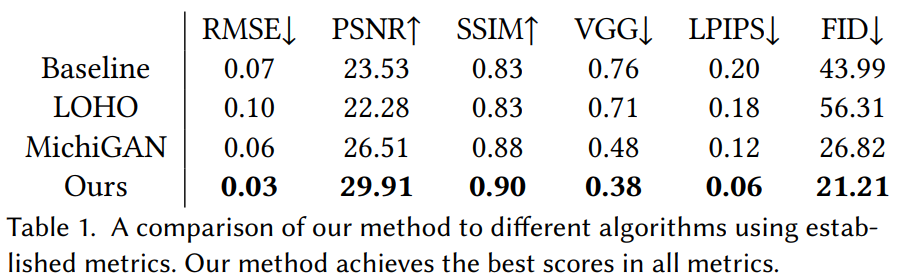

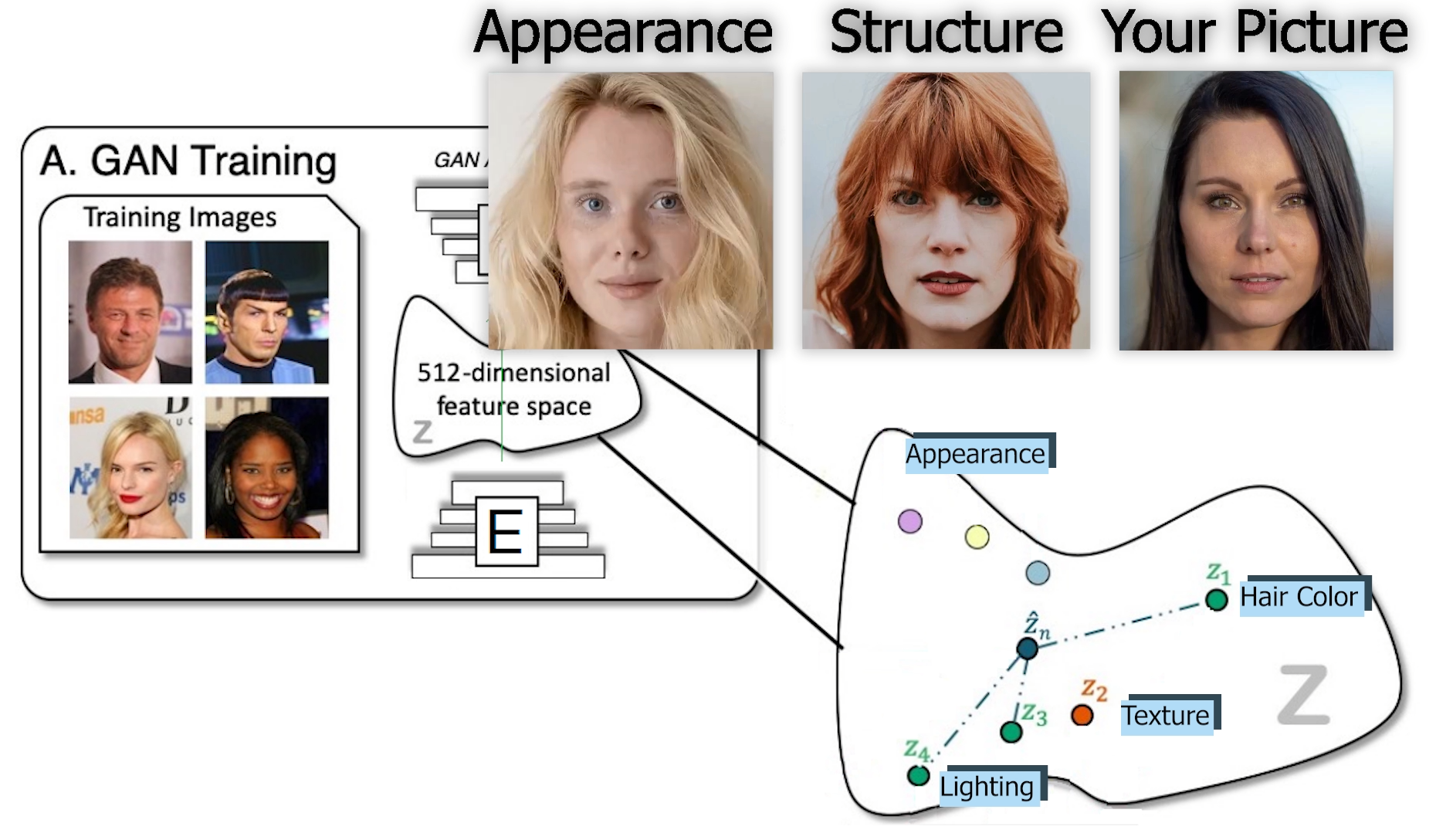

Как вы можете подозревать, мы здесь играем с лицами, поэтому в нем используется очень похожий процесс, как и в предыдущих статьях, которые я рассматривал, изменяя лицо на карикатуры или другие стили, которые все используют GANs. Поскольку это очень похоже, я позволю вам посмотреть другие мои видео, где я подробно объяснил, как работают GAN, и я сосредоточусь на том, что нового в этом методе и почему он так хорошо работает.

Архитектура GAN может научиться переносить определенные функции или стили изображения на другое. Проблема в том, что они часто выглядят нереалистично из-за различий в освещении, возможных окклюзий или даже просто положения головы, которые различаются на обоих снимках. Все эти мелкие детали делают эту проблему очень сложной, вызывая артефакты в сгенерированном изображении. Вот простой пример, чтобы лучше визуализировать эту проблему: если вы возьмете волосы кого-то с фотографии, сделанной в темной комнате, и попытаетесь надеть их на себя снаружи при дневном свете, даже если они идеально наложены на вашу голову, это все равно будет выглядеть странно. Как правило, эти другие методы, использующие GAN, пытаются закодировать информацию изображений и явно идентифицировать область, связанную с атрибутами волос в этой кодировке, чтобы переключить их. Это хорошо работает, когда два снимка сделаны в одинаковых условиях, но большую часть времени это будет выглядеть нереально по причинам, которые я только что упомянул. Затем им пришлось использовать другую сеть, чтобы исправить повторное освещение, дыры и другие странные артефакты, вызванные слиянием. Итак, цель здесь состояла в том, чтобы перенести прическу и цвет конкретной фотографии на вашу собственную фотографию, изменив результаты, чтобы они соответствовали освещению и свойствам вашей фотографии, чтобы сделать ее убедительной и реалистичной одновременно, сократив количество шагов и источников ошибок.

Если этот последний абзац был неясен, я настоятельно рекомендую посмотреть видео в конце этой статьи, поскольку там есть больше наглядных примеров, которые помогут понять.

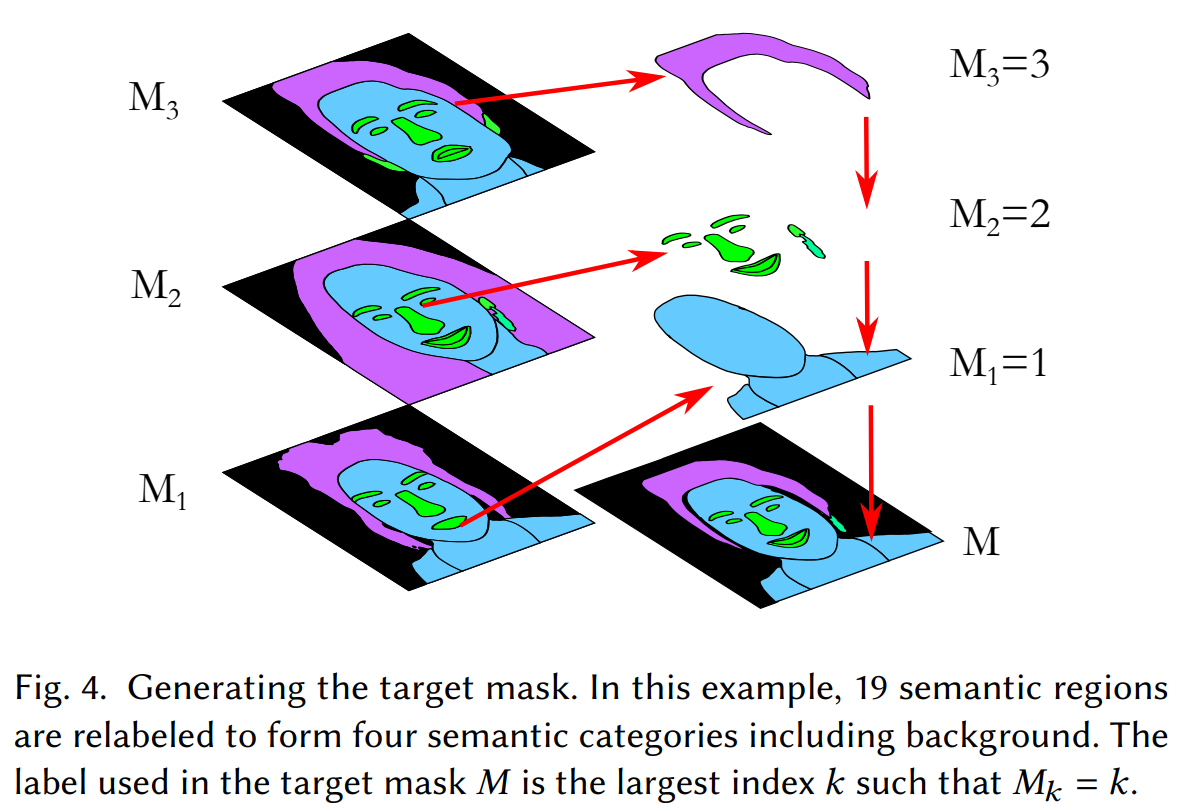

Чтобы достичь этого, Пей Хао Чжу и др. добавили недостающий, но важный шаг выравнивания в Банды. Действительно, вместо того, чтобы просто кодировать изображения и объединять их, он немного изменяет кодировку после другой маски сегментации, чтобы сделать скрытый код из двух изображений более похожим. Как я уже упоминал, они могут редактировать как структуру, так и стиль или внешний вид волос.

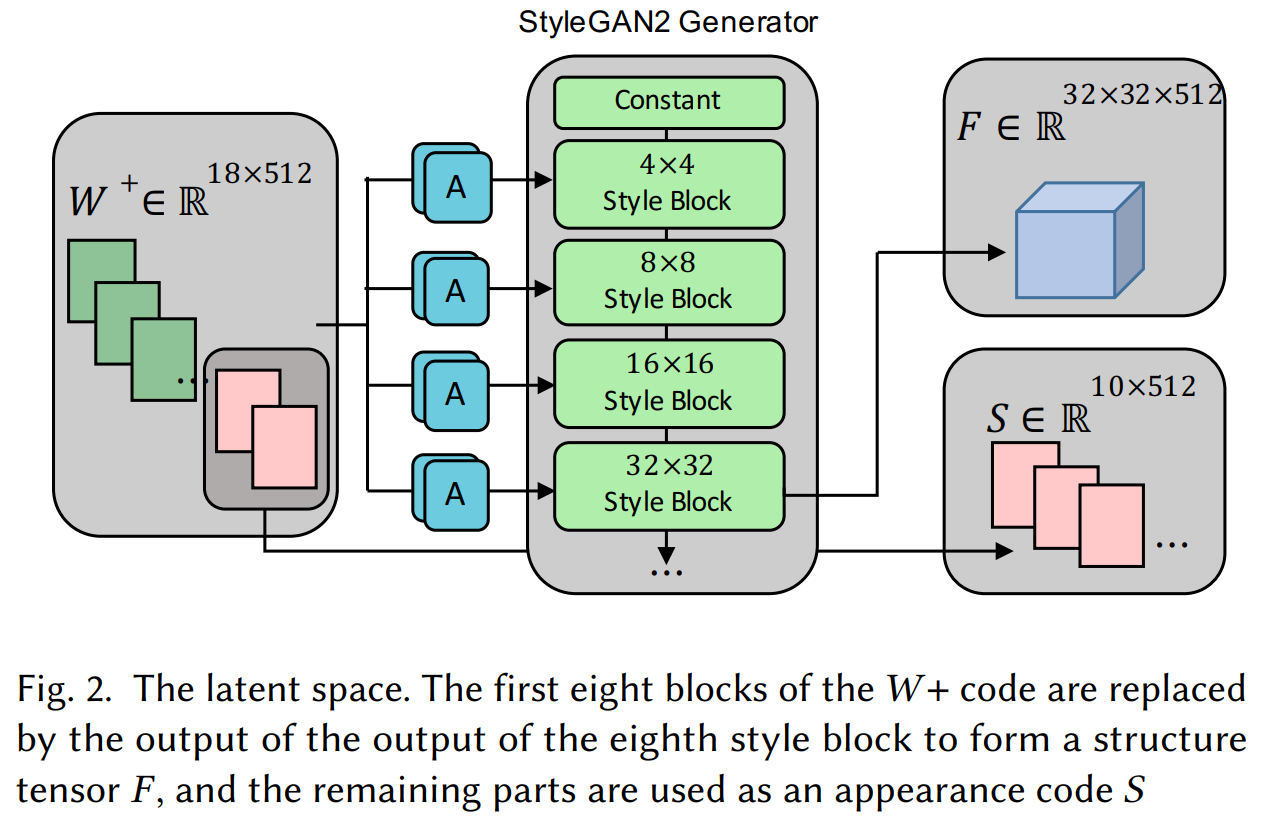

Здесь структура — это, конечно же, геометрия волос, которая говорит нам, вьющиеся они, волнистые или прямые. Если вы видели другие мои видео, вы уже знаете, что гены кодируют информацию с помощью свертки. Это означает, что он использует ядра для уменьшения масштаба информации на каждом уровне и делает ее все меньше и меньше, таким образом итеративно удаляя пространственные детали, придавая все большую ценность общей информации для результирующего вывода. Эта структурная информация получена, как всегда, из ранних слоев изображения, поэтому до того, как кодирование станет слишком общим и, ну, слишком закодированным, чтобы представлять пространственные объекты.

Внешний вид относится к глубоко закодированной информации, включая цвет волос, текстуру и освещение. Вы знаете, откуда берется информация из разных изображений, но теперь, как они объединяют эту информацию и делают ее более реалистичной, чем предыдущие подходы?

Это делается с помощью карт сегментации из изображений. И, более точно, создание этого желаемого нового изображения на основе выровненной версии нашего целевого и эталонного изображения. Эталонное изображение — это наше собственное изображение, а целевое изображение — прическа, которую мы хотим применить. Эти карты сегментации сообщают нам, что содержит изображение и где оно находится: волосы, кожа, глаза, нос и т.д.

Используя эту информацию из разных изображений, они могут выровнять головки в соответствии со структурой целевого изображения перед отправкой изображений в сеть для кодирования с использованием модифицированной архитектуры на основе StyleGAN2. Тот, о котором я уже рассказывал много раз. Такое выравнивание делает закодированную информацию гораздо более легко сопоставимой и восстанавливаемой.

Затем, для решения проблемы внешнего вида и освещения, они находят подходящее соотношение смешивания этих кодировок внешнего вида из целевого и эталонного изображений для одних и тех же сегментированных областей, что делает его максимально реальным. Вот как выглядят результаты без выравнивания в левом столбце и их приближения справа.

Конечно, этот процесс немного сложнее, и все подробности можно найти в статье, на которую есть ссылки в ссылках. Обратите внимание, что, как и в случае с большинством реализаций GANs, их архитектуру необходимо было обучить. Здесь они использовали сеть на основе StyleGAN2, обученную на основе набора данных FFHQ. Затем, поскольку они внесли много изменений, как мы только что обсуждали, они обучили свою модифицированную сеть StleGAN2 во второй раз, используя 198 пар изображений в качестве примеров передачи прически, чтобы оптимизировать модельное решение как для соотношения внешнего вида, так и для структурных кодировок.

Кроме того, как и следовало ожидать, все еще существуют некоторые недостатки, подобные этим, когда их подход не позволяет вам выравнивать маски сегментации или реконструировать лицо. Тем не менее, результаты чрезвычайно впечатляют, и здорово, что они открыто делятся своими ограничениями.

Как они заявляют в документе, исходный код их метода будет обнародован после окончательной публикации статьи. Ссылка на официальное репозиторий GitHub находится в ссылках ниже, в надежде, что оно будет выпущено в ближайшее время.

Источник: www.louisbouchard.ai