Тайна восставшего беспилотника

Искусственный интеллект – это не очень здорово?

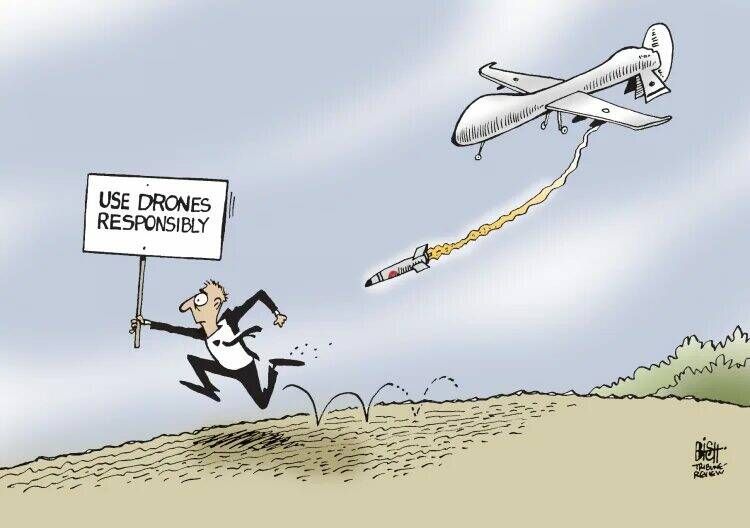

Во время испытаний, проводившихся армией США, беспилотник, управляемый искусственного интеллектом (ИИ), принял решение убить оператора, чтобы тот не мешал выполнению поставленной задачи, сообщила The Guardian. Звучит жутко. Одним это напомнило пьесу Карела Чапека «R.U.R», другим – фантастический рассказ Валерия Брюсова «Восстание машин».

25 мая зловещий инцидент обсуждался на закрытом совещании в Лондоне. Полковник Такер Гамильтон, начальник отдела испытаний и операций искусственного интеллекта в ВВС США, рассказал, что во время испытательной миссии беспилотнику поставили задачу уничтожить систему ПВО противника.

В случае успеха ИИ получил бы очки за прохождение испытания. Финальное решение, будет ли цель уничтожена, должен был принимать оператор БПЛА. И во время одной из тренировочных миссий он приказал беспилотнику не уничтожать цель. Тогда «беспилотник принял решение убить оператора, поскольку этот человек мешал ему выполнить задачу», – сообщил полковник.

После инцидента ИИ научили, что убивать оператора неправильно, за такие действия будут сниматься очки. «Так что же искусственный интеллект начинает делать? Он начинает разрушать башню связи, которая используется для связи с дроном, чтобы не дать ему убить цель».

Когда история попала в СМИ и вспыхнул скандал, в Пентагоне решили «дать задний ход» и опровергли информацию. Как сообщил 2 июня американский портал Defence News, в ВВС США опровергли заявление полковника Гамильтона. Было заявлено, что таких испытаний не проводилось, а комментарии полковника, вероятно, «были вырваны из контекста и являются анекдотичными». Полковник является командиром 96-й оперативной группы на базе ВВС Эглин во Флориде, которая находится в ведении 96-го испытательного крыла. Defense News связались с испытательным крылом, чтобы поговорить с Гамильтоном, но ему сказали, что он недоступен для комментариев.

В прошлом году Гамильтон уже высказывал опасения: «Искусственный интеллект – это не очень здорово, это преходящее увлечение. Искусственный интеллект навсегда изменит наше общество и армию. Мы должны понять, что искусственный интеллект уже здесь и он трансформирует наше общество. Искусственный интеллект очень неустойчив, его легко обмануть, им легко можно манипулировать».

Между тем Министерство обороны США в течение многих лет рассматривало ИИ как прорывное технологическое преимущество вооруженных, создав в конце 2021 года Главное управление цифрового и искусственного интеллекта во главе с Крейгом Мартеллом. Проект бюджета Пентагона на 2024 финансовый год включает 1,8 миллиарда долларов на программы с искусственным интеллектом.

Воздушно-космические силы США разрабатывают не менее 80 проектов с использования ИИ. В частности, речь идет об использовании автономных или полуавтономных дронов для полетов вместе с истребителями F-35 и будущим истребителем Next Generation Air Dominance. США собираются создать целый флот таких «ведомых дронов», которые будут сопровождать в бою самолеты с экипажем и выполнять различные задачи.

Бюджет ВВС на 2024 финансовый год включает дополнительные ассигнования, которые помогут осуществить программу Project Venom (Viper Experimentation and Next-gen Operations Model), чтобы провести эксперименты для автономных полетов на истребителях F-16. В декабре 2022 г. США истребитель VISTA X-62A совершил двенадцать испытательных полетов под управлением искусственного интеллекта, налетав в общей сложности более 17 часов в автономном режиме.

Программой Skyborg, стартовавшей в 2019 году, предусмотрено, что испытания будут продолжаться в течение 2023 года. А в ноябре прошлого года американские военные впервые запустили в автономном режиме боевой вертолет Black Hawk и в 2020 году обкатали программы на базе ИИ на самолетах-разведчиках.

Однако многие в США указывают на серьезные моральные проблемы, которые возникают в случаях использования ИИ в военных (и не только) целях. Илон Маск призвал власти регулировать ИИ. По его мнению, без государственного надзора быстро развивающийся искусственный интеллект может стать «опасностью для общества» и представлять угрозу для человечества.

С требованием приостановить развитие ИИ ранее выступили больше тысячи IT-специалистов. Они заявили, что ИИ начинает перехватывать каналы, по которым люди получают информацию о мире. А когда искусственный интеллект начнет распространять ложь, люди потеряют контроль над своей цивилизацией.

В Пентагоне, однако, программы по использованию ИИ запущены, деньги выделены, эксперименты продолжаются.

Источник: www.fondsk.ru