Нестандартные уравнения: как искусственный интеллект ищет мельчайшие иголки в гигантском стоге сена научных возможностей

Изображение, сгенерированное нейросетью в ответ на запрос «ИИ в роли ученого» / ©Naked Science

Технологии искусственного интеллекта проникают во все сферы жизни. Наука не исключение — ученые начинают использовать машинное обучение все активнее, и за ним уже есть реальные научные достижения. Но это лишь прелюдия: ИИ явился не просто помочь с расчетами, его роль в будущем масштабнее — он усилит наше мышление, указывая на взаимосвязи, которые человеческому уму не видны. Наука изменится. Naked Science полагает, что у нее появился новый способ изучать мир.

Историки знают, что Петр I писал неразборчиво. Сохранились его письма, пометки, черновики, их тысячи, и до недавних пор больше половины не были расшифрованы, изучены и переведены в печатный текст. Как пояснил Константин Могилевский, председатель правления Российского исторического общества: «Петр I писал много, писал быстро, писал плохим почерком, с сокращениями, с использованием иностранных слов». С рукописью государя не любой историк совладает, это отдельное умение, и разбор одной страницы займет даже у эксперта несколько часов. Чтобы ощутить сложность задачи, загляните в электронный архив петровских документов. Писал-то человек и легко, и стремительно, а вот попробуй-ка прочти.

В этом году Россия отметила 350-летие со дня рождения Петра Великого. Готовясь к юбилею заранее, Российское историческое общество и «Сбер» при участии Санкт-Петербургского научно-исследовательского института РАН еще в 2020 году инициировали конкурс по расшифровке рукописного наследия Петра I с помощью искусственного интеллекта. В итоге возник проект «Digital Петр», где рукописи государя читает нейросеть, обученная на его ранее расшифрованных документах. За минуту она распознает до 35 страниц и справляется заметно лучше, чем европейская Transcribus, похожая программа для чтения древних рукописей.

Рукопись письма Петра I князю Долгорукому

Рукопись письма Петра I князю Долгорукому

Спасение от накатывающей сложности

Наука всегда извлекала пользу из новых инструментов. Телескопы позволили нам вглядеться вдаль, микроскопы — вглубь, открывая мельчайшие детали мироздания и самые дальние объекты, о которых мы не узнали бы никогда. Еще в прошлом веке ученые сразу оценили компьютер как новый мощный инструмент, используя его для сложных расчетов, моделирования и хранения данных. Однако теперь взлет глубоких нейронных сетей и машинного обучения предвещает науке нечто гораздо большее, чем помощь в вычислениях. Кажется, это изменит сам способ познания мира.

Условия для таких перемен уже почти созрели. Поток данных, который скоро захлестнет науку, ставит ученых в положение, в котором прежние поколения не оказывались, ведь раньше данных всегда не хватало. Теперь же, например, в космологии и физике в ближайшее десятилетие появятся огромные массивы данных от ускорителей, токамаков и телескопов. Один только радиотелескоп Square Kilometer Array, запуск которого запланирован на вторую половину 2020-х, будет ежегодно генерировать примерно столько же трафика, сколько недавно давал весь интернет. Еще один растущий поток данных пойдет из биоинформатики и нейробиологии.

Другая тенденция — вал научных публикаций. Сегодня один ученый не в силах отследить и прочесть все статьи, выходящие даже по его (ее) узкой тематике. Приходится выбирать в основном те, что на виду и активно цитируются. Поскольку так поступают все, то «лавина новых публикаций лишь укрепляет наиболее цитируемые статьи», фактически замедляя научный прогресс. Для человека уже невозможно физически разобрать большую долю работ и оценить изложенные в них идеи, даже если тратить все время только на чтение.

Но и сама научная инфраструктура — ускорители, симуляции, базы данных — вскоре достигнет таких масштабов и сложности, что даже управлять ею в реальном времени с помощью простых правил и процедур не получится. Кроме того, ученые исследуют климат, экономику, экосистемы, психику человека. Иными словами, то, над чем работают ученые, и то, на чем они работают, становится чрезвычайно сложным и запутанным. Прежние методы науки не рассчитаны на такую сложность, а в сутках по-прежнему 24 часа. Так что нейронные сети пришли как раз вовремя.

В поисках скрытых связей

«Есть вещи, которые мы, люди, просто не можем сделать», — признает Брант Робертсон, профессор астрономии и астрофизики из UCSC. Вместе с аспирантом он создал нейросетевую программу Morpheus, обучив ее на снимках глубокого космоса от телескопа Хаббл. Программа сканирует новые космические снимки высокого разрешения и выделяет на них звезды и разные типы галактик. Даже на небольшом участке неба рассыпаны миллионы объектов — и, опять же, оцените сложность задачи — нейросеть различает их все. Помимо классификации галактик, машинное обучение в астрофизике уже используют для поиска пульсаров и сверхновых, а также для изучения свойств звезд.

Для того чтобы проанализировать неисчислимое количество объектов на снимках глубокого космоса, нужен искусственный разум — обычного человеческого уже недостаточно / ©FotoTips.ru

Для того чтобы проанализировать неисчислимое количество объектов на снимках глубокого космоса, нужен искусственный разум — обычного человеческого уже недостаточно / ©FotoTips.ru

Смотреть можно не только с Земли на небо, но и в обратном направлении. Спутники шлют снимки поверхности планеты, и тогда желательно очистить их от шума вроде облаков, теней, дыма и разных артефактов. Компании «Роскосмоса» — «Российские космические системы», НИИ ТП и ТЕРРА ТЕХ — разработали программу на основе нейросетей, которая удаляет все подобные шумы, оставляя на снимках информацию, важную для навигации, изучения недр и прочих нужд.

Подобные примеры использования искусственного интеллекта, а их будет все больше, строятся на одной ключевой особенности глубоких нейросетей — они исключительно хорошо учатся находить взаимосвязи и закономерности, скрытые в данных, а также сопоставлять одни паттерны с другими. Для ученых это настоящая находка.

Нейросети учатся и прогнозируют

Вероятно, первым крупным успехом глубокого обучения в науке стало предсказание трехмерной структуры белка. Любой белок — это замысловато свернутая цепочка аминокислот, от чего и зависит его функция. Вычислить 3D-форму, зная только цепочку, трудно и дорого. В компании DeepMind обучили нейросеть AlphaFold на структурах, что уже были решены экспериментально, а затем использовали ее для белков, по которым решения нет. По сути, AlphaFold предсказывает расстояния между парами аминокислот и углы между их связями и так дает прогноз пространственной структуры с точностью до атома.

И если в прошлом, 2021-м, году DeepMind отчиталась предсказанием по 350 тысячам белков, что стало громким научным событием, то в этом году уже получены вероятные структуры почти всех известных науке белков, а это свыше 200 миллионов молекул. Авторы разместили их в открытой базе данных, так что теперь биологи всего мира могут легко найти 3D-структуру любого белка, что ценно не только для фундаментальных исследований, но и, например, для разработки лекарств.

Глубокое обучение нейронных сетей также используют в российском Центре искусственного интеллекта НИУ ВШЭ для изучения вторичных структур ДНК. Основная задача — найти расположение функциональных элементов на двойной спирали. Это ключ к пониманию работы генома, ведь именно с такими участками ДНК связываются активные молекулы, влияющие на экспрессию генов. Также в Центре искусственного интеллекта используют нейросети для предсказания трехмерных структур антител.

Похожим образом в неорганической химии ученые пытаются предсказывать кристаллические структуры. Знание структуры вещества позволяет судить о его свойствах, но для этого нужно найти расположение его атомов, которое обладает наименьшей энергией, оно-то и будет стабильной формой вещества. Артем Оганов, профессор Сколтеха и РАН (кроме того, он создал в МФТИ лабораторию компьютерного дизайна материалов), занимается дизайном материалов и использует машинное обучение, чтобы избежать громоздких квантово-механических расчетов: ИИ находит стабильные структуры гораздо быстрее, порой ускоряя поиск в тысячи раз.

В лаборатории Оганова нейросеть обучают на данных о кристаллических структурах, для которых расчет уже произведен и их энергия известна. По мере обучения ИИ улавливает связь между расположением атомов и энергией и далее использует это «понимание» для предсказания энергии любых новых структур. Это открывает возможность изучать свойства веществ в условиях, которых никто не наблюдал (например, если они находятся глубоко в мантии Земли) и «сочинять» новые материалы с заданными свойствами.

Тот же принцип работает и в квантовых технологиях. Например, физики из МФТИ, ФТИАН и Университета ИТМО создали нейронную сеть, которая предсказывает, «глядя» на схему узлов и связей, будет ли та обладать квантовым преимуществом. Проще говоря, подходит ли ее конфигурация (граф) для создания на ее основе квантовых систем. Если чуть сложнее, дадут ли квантовые блуждания внутри этой схемы выигрыш в скорости вычислений.

Почему нейросетям удаются такие трюки? Ответ «прост»: прогноз будет надежен, если в данных содержится устойчивый паттерн, который отражает некую фундаментальную закономерность. Скажем, за свертыванием всех белков стоит одна и та же биофизика, поэтому корреляции, пойманные ИИ в обучающей выборке, актуальны и для всех прочих белковых молекул. За счет этого, оказалось, удается решать множество самых разных задач в физике или химии, нерешаемых путем формул и вычислений в лоб.

От прогнозов к дизайну

В нулевые Александр Жаворонков учился на кафедре биофизики физического факультета МГУ, а сегодня возглавляет компанию Insilico Medicine, которую сам же основал. Компания ведет исследования в области генеративной химии и ищет способ сократить время и затраты на разработку новых молекул для фармакологии. В этой сфере все низко висящие плоды давно сорваны. Найти соединение, которое работает лучше уже известных, стоит огромных усилий. Может ли ИИ как-то упростить задачу?

В середине 2010-х Жаворонков в числе первых заинтересовался глубоким обучением применительно к созданию биомолекул. Чуть позже сотрудники Insilico в числе первых показали, как с помощью нейросетей, используя систему генеративного тензорного обучения с подкреплением, можно подобрать молекулу с нужными свойствами. Они искали ингибитор для киназы, участвующей в развитии фиброза, и разработка заняла всего три недели. Далее молекулу синтезировали и испытали уже не виртуально, а на живых мышах, и она показала свою эффективность, о чем компания сообщила в журнале Nature Biotechnology.

Результат не был идеальным, но он «доказал концепцию», как выражаются ученые. Проще говоря, все увидели, что нейросетевые модели могут проектировать биомолекулы. Конечно, ИИ лучше проявляет себя на коротких молекулах и когда уже есть много похожих данных для обучения. И все становится труднее, если речь идет о сложных мишенях, таких как ионные каналы, факторы транскрипции или белок-белковые взаимодействия. Но этот пример иллюстрирует важную идею — ИИ в науке годится не только для предсказаний, но и для создания нового.

Предсказание структуры белков по их последовательностям может помочь в разработке лекарств / ©Эдвард Кинсман, Science Photo Library.

Предсказание структуры белков по их последовательностям может помочь в разработке лекарств / ©Эдвард Кинсман, Science Photo Library.

Примерно как большие нейросетевые модели генерируют изображения и тексты, так же они могут быть обучены порождать новые белковые последовательности. В случае с текстом аналогия прямая, ведь белки — своего рода фразы из генетических букв, и в них есть биологический смысл. Ученые, работающие в этой области, ожидают, что уже скоро большую часть неизвестных ранее белков будут проектировать с помощью генеративных нейросетей, похожих на языковые модели.

Нестандартная модель. Некрасивые уравнения. Нечеловеческая математика

Если искусственный интеллект поможет ученым экономить время и деньги на громоздких расчетах, то он и так уже себя с лихвой оправдает. Однако при всех успехах в распознавании или предсказании свойств и структур, в действительности он обещает науке неизмеримо больше — ИИ может вдохновлять ученых на принципиально новые идеи и концепции, на новую глубину понимания природы.

Физики уже используют машинное обучение для анализа данных, полученных в ходе экспериментов на Большом адронном коллайдере, от нейтринных детекторов и наблюдений темной материи. И открыто признают, что ИИ должен им помочь в поисках новой фундаментальной физики. Здесь как раз потребуется ловить иголки в стоге сена, то есть в огромном объеме многомерных данных замечать очень редкие и тонкие аномалии. Они и приведут к физике за пределами стандартной модели.

Есть и другое ожидание. Как пишут российские исследователи, рассуждая о роли искусственного интеллекта в науке, он мог бы взять на себя вопросы, которыми ученые пренебрегают просто в силу сложившегося научного мышления. Как подметил Константин Новоселов, нобелевский лауреат по физике 2010 года, «физики в целом не любят задач, которые не описываются небольшим количеством красивых уравнений»: «Поэтому, если возникает необходимость написать уравнение в полстраницы, физик скорее всего решит, что в его рассуждении что-то пошло не так». Здесь ИИ как раз может помочь в работе с «некрасивыми» громоздкими уравнениями.

Похожие задачи есть и в чистой математике, например более двух сотен страниц доказательства одной теоремы из теории групп проверяли программой Coq. Математика становится сложнее, длина доказательств растет, и не известно, справится ли разум человека с такой нарастающей сложностью в будущем. Вполне вероятно, что ИИ станет не просто помощником, но и коллегой — будет открывать и затем доказывать новые теоремы. Здесь снова пригодится его «сверхъестественное» умение отслеживать связи и паттерны в сложных многомерных данных.

На математическом поле активно работают исследователи из DeepMind, которые в прошлом году выпустили статью с амбициозным заголовком «Развитие математики за счет направления человеческой интуиции с помощью ИИ» — авторы показали, что ИИ находит новые нетривиальные корреляции и отношения между математическими объектами, не замеченные людьми. В свою очередь, это призвано помочь математикам выдвигать новые гипотезы и теоремы.

А уже в этом году сотрудники DeepMind представили программу AlphaTensor, которая нашла алгоритмы умножения матриц, более эффективные, чем те, что известны науке. Матричное умножение используют во многих практических задачах, от графических процессоров до цифровой связи, и там даже небольшое улучшение сильно ускоряет расчеты. AlphaTensor был создан как нейросетевой агент, обученный играть в игру, где нужно найти решение с наикратчайшей цепочкой ходов. Важное условие — агент вошел в игру без знаний каких-либо алгоритмов умножения матриц. Он нашел «мельчайшие иголки в гигантском стоге сена возможностей», превзойдя интуицию человека.

ИИ — искусственный исследователь

За последние годы стало ясно, что, глядя на ИИ в науке, мы видим лишь надводную часть айсберга. Решающий вклад ИИ будет не в замене громоздких расчетов, хотя и это окажет колоссальное влияние на все сферы жизни, а в том, что он станет новым инструментом мышления, помогая ученым выйти за рамки своей интуиции. При всей практической важности, предсказание структур белка не меняет нашей картины мира — это демонстрация законов природы, которые уже открыты. Подлинно научный ИИ научится открывать законы.

И уже первые эксперименты, пока на уровне «доказательства концепции», показывают, что алгоритмы способны строить физические модели из данных. Например, одна из программ пришла к тому же выводу, что и Коперник: по данным о движении Солнца и Марса, как их видно с Земли, вывела гелиоцентрическую модель Солнечной системы. Другая открыла закон тяготения Ньютона, ознакомившись со статистикой движения планет и крупных лун Солнечной системы за 30 лет. Программе ничего заранее не сообщили о массах планет или физических константах. Их она тоже вывела сама.

Ширли Хо, астрофизик и одна из авторов исследования, поясняет, что это лишь пробный шар: «Мы начали с повторного открытия того, что уже известно, так мы убедились, что машинный подход работает, а дальше уже попытаемся открыть то, чего не знаем». Так одно из величайших открытий в истории науки, к которому люди шли столетиями через идеи Птолемея и Кеплера, для ИИ оказалось довольно тривиальной задачей. Причем программа решила ее через подбор уравнений, которые наиболее точно согласуются с данными.

Метод называется символьной регрессией, и он в чем-то похож на генетические алгоритмы. В огромном пространстве математических выражений программа ищет то, которое и проще, и лучше всего отражает данные. Ценность метода в том, что машина выдает результат в виде уравнений, что удобно для людей, ведь уравнение прямо показывает взаимосвязь разных величин, и его сразу можно применить к другим данным. Эта работа в чем-то обратна предсказанию структур — здесь ИИ сообщает не как будет, а почему, представляя зависимость в явном виде.

На самом деле, начиная со времен Ньютона и даже до него ученые делают то же самое — ищут закономерности в наборе данных. Они пытаются обнаружить закон, который объяснит их наблюдения, в виде формул или модели. Возможно, используя машинное обучение, они смогут продвигаться на этом пути дальше — ИИ увидит те закономерности, что мы упускаем просто в силу нашей физиологии. Объем рабочей памяти человека ограничен, мы не можем воспринимать и удерживать в уме миллионы параметров, нам с трудом даются сложные взаимосвязи и многомерные пространства. Эволюция не готовила нас к такому, зато для ИИ такие пространства — естественная среда обитания.

Фантазируя о будущем, ученые называют этот способ изучать природу с помощью регрессий «физикой GoPro» — просто наведите камеру на событие и получите уравнение, отражающее суть происходящего. Вряд ли так удастся описать сложное поведение, например, высших животных, но когда речь идет о вращении планет, вихрях в жидкости и делении клеток, лаконичные уравнения могут быть поразительно точны. И отдельный интригующий вопрос: может ли ИИ найти другие — более простые или более интересные — формулы и способы представления уже известных законов? По сути, это вопрос о том, может ли ИИ открыть нам иные модели физики.

Третий способ познания

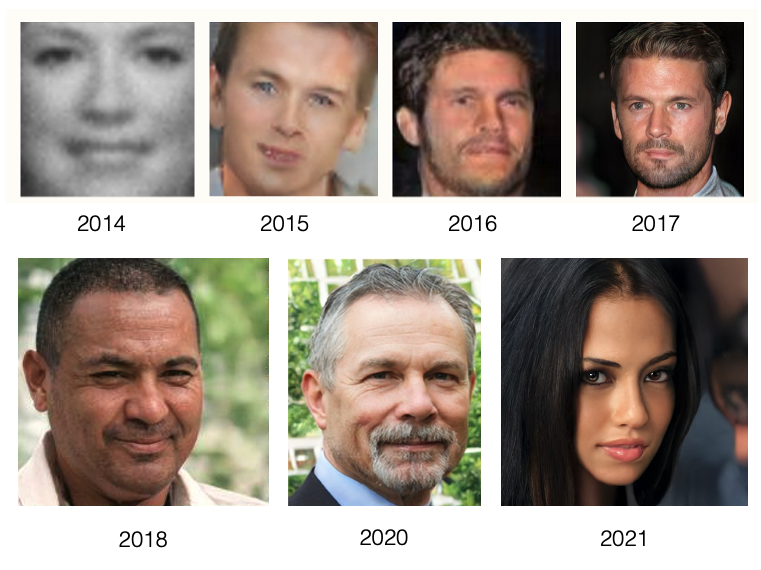

Впрочем, можно обойтись и без формул. Когда нейросеть, обученная на портретных фотографиях, генерирует фото несуществующих людей, мы оцениваем результат. Мы можем попросить программу состарить лицо или объединить в нем черты двух людей. Нейросеть «знает», от каких параметров зависит точность решения, но знание разлито по всей сети, оно не выразимо простыми уравнениями. Зато вы можете безгранично создавать вариации лиц, и это знание придет вам через них.

Генерация лиц с использованием генеративного моделирования значительно улучшилась за последние восемь лет / ©David Foster

Генерация лиц с использованием генеративного моделирования значительно улучшилась за последние восемь лет / ©David Foster

Оказалось, тот же принцип можно использовать и в науке. Его называют генеративным моделированием, и он работает на генеративно-состязательных нейросетях. Модель обучают на реальных данных экспериментов или наблюдений, а затем она создает синтетические данные как способ проверки гипотез. Так удалось выяснить, от чего зависит затухание звездообразования в галактиках. Швейцарские астрофизики из ETH Zurich загрузили в модель данные о галактиках, находящихся в среде с низкой плотностью, и попросили показать, как бы выглядели эти галактики в среде с высокой плотностью. Не правда ли очень похоже на задание состарить лицо на фото?

Что отличает этот подход от обычного моделирования — программе не дают заранее никаких правил и знаний о физических процессах, только исходные данные. По сути, ИИ ищет взаимосвязи между разными параметрами и узнаёт, как изменятся одни параметры, если изменить другие. Так можно проверить огромное множество сценариев, включая и те, что никогда не удастся наблюдать. Для ученых ключевой вопрос здесь в том, сколько всего полезной информации скрыто в данных и как ее извлечь по максимуму.

Здесь генеративное моделирование в чем-то перекликается с физикой GoPro, ведь в обоих случаях ИИ ищет ответы, ничего не зная о наших теориях. Интересно, смог бы ИИ заново открыть все то, что мы уже знаем о природе, имея исключительно сырые данные? И как бы выглядела его картина мира? Будоражащие вопросы, на которые еще предстоит найти ответ. Некоторые ученые называют генеративное моделирование «третьим способом» познания Вселенной (наряду с наблюдением и обычным моделированием), подчеркивая его независимость от теорий. Другие замечают, что многие открытия в физике происходят до того, как появится теория или объясняющая модель.

Эта история только начинается, и мы пока не знаем, как глубоко мы продвинемся с помощью ИИ в постижении тайн Вселенной. Данных скоро будет неимоверно много, а нейросети как раз умеют находить скрытые связи в сложных данных. Одно это позволяет рассчитывать на богатый улов. Но есть и другой, менее очевидный, намек на то, что системы ИИ могут быть исключительно успешны в науке. Не так давно сразу две команды ученых, независимо друг от друга, пришли к необычной идее: Вселенная похожа на программу машинного обучения и, вероятно, непрерывно обучается!

Источник: naked-science.ru